Meta* оптимизировала технологию аватаров Codec Avatars для одновременного рендеринга трёх полноразмерных аватаров на Quest 3, но это потребовало пойти на значительные компромиссы. Результаты снова ставят вопрос о возможности появления такой репрезентации человека на Quest в обозримом будущем.

Почти десять лет Meta разрабатывала технологию Codec Avatars — фотореалистичные цифровые изображения людей, которые могут воспроизводить мимику и жесты человека в реальном времени с помощью отслеживания лица и глаз. Цель проекта состоит в обеспечении так называемого социального присутствия, подсознательного ощущения присутствия человека рядом, несмотря на то, что физически он в другом месте. На такое не способна ни одна современная технология, особенно с применением обычных мониторов. Помимо Meta, наиболее эффектные попытки предпринимают Apple и Google.

Meta работает над повышением реалистичности и адаптивности Codec Avatars, снижением требований к рендерингу в реальном времени и возможностью их генерации с помощью сканирования тела смартфоном. Последним прогрессом для аватаров (но пока с одной лишь головой) стала возможность их создания из видеоселфи с поворотом головы и примерно часом обработки на серверном графическом процессоре. Это стало возможным благодаря технологии распределения Гаусса, которая в последние годы сыграла для реалистичного объёмного рендеринга ту же роль, что большие языковые модели для чат-ботов.

Однако эта система всё ещё разрабатывалась для мощных видеокарт. Теперь инженеры Reality Labs нашли способ запустить аватары в полный рост в режиме реального времени на Quest 3.

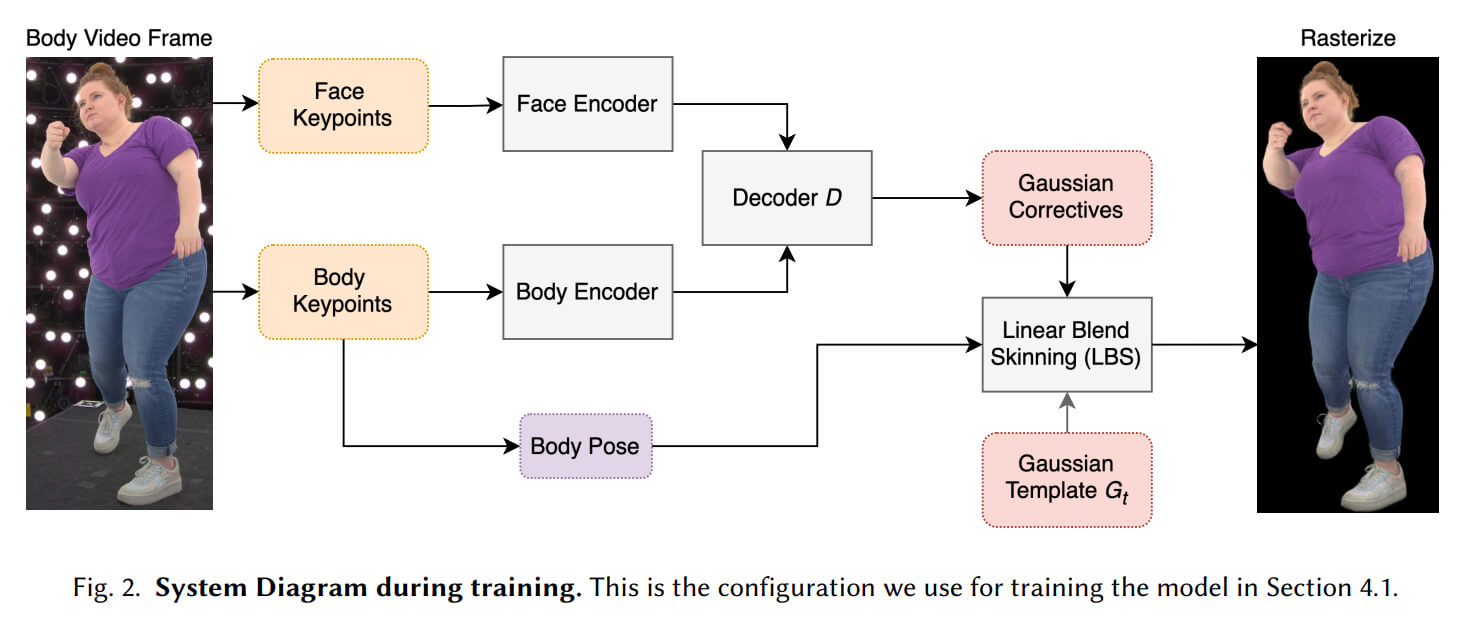

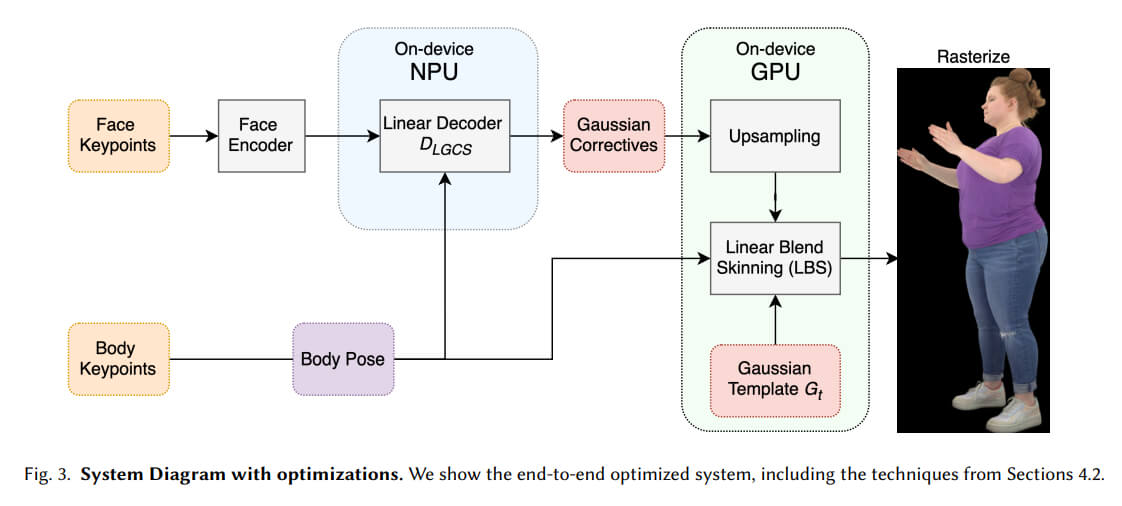

В статье под названием «SqueezeMe: мобильная версия гауссовых аватаров в полный рост» исследователи описывают адаптацию для работы на мобильном железе с использованием графики и нейропроцессора. Возможно, вы слышали термин «дистилляция» в контексте нейронных сетей — он подразумевает использование выходных данных большой и затратной модели для обучения гораздо меньшей модели. Идея в том, что небольшая модель может эффективно воспроизводить результаты большой с минимальной потерей качества.

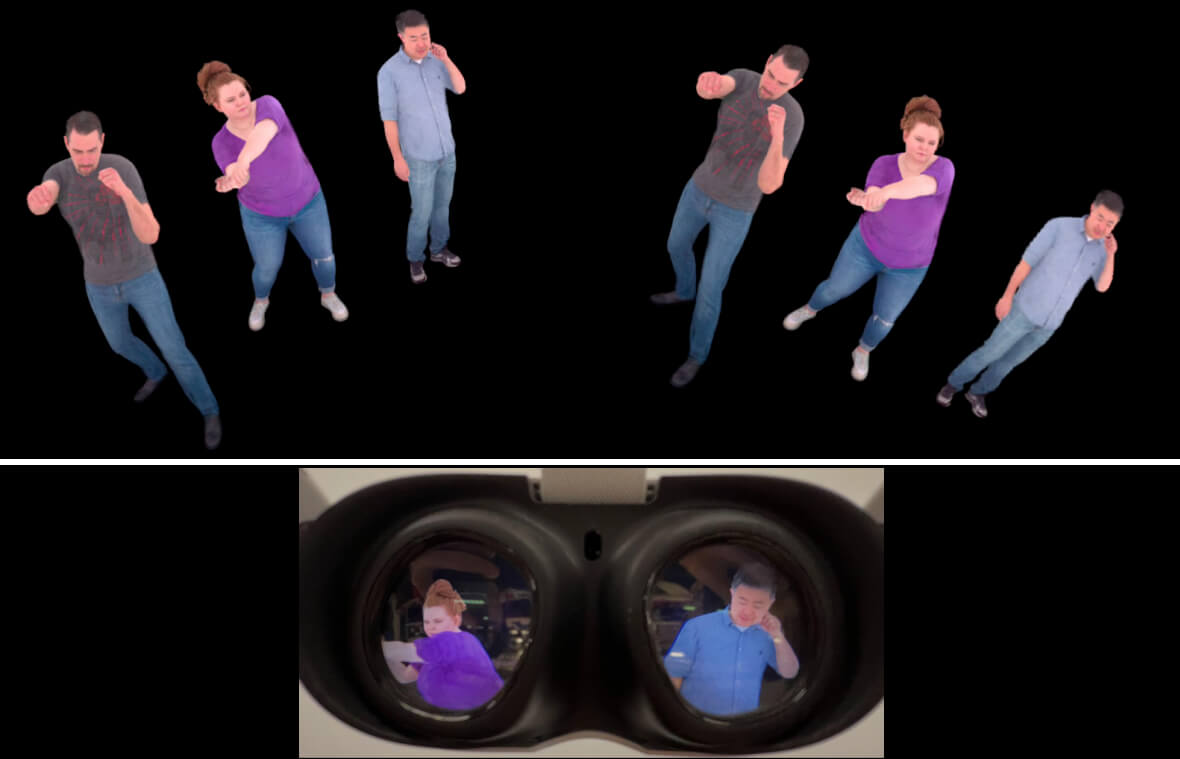

Авторы работы утверждают, что SqueezeMe может выдавать три полноразмерных аватара со скоростью 72 кадра в секунду на Quest 3 практически без потери качества по сравнению с версиями, отрисованными на ПК. Однако у такого подхода есть ряд важных недостатков.

Аватары генерируются с использованием традиционного массива пользовательских изображений, который получают в куполе диаметром три метра с более чем сотней камер и 1024 источниками света. Новый подход со смартфонным сканированием тут пока неприменим. Здесь плоское освещение без поддержки динамического переосвещения, которое остаётся прерогативой больших компьютеров.

Тем не менее, исследование позволило сделать многообещающих шаг к тому, чтобы Codec Avatars стали функцией очков на Horizon OS. Только для этого предстоит выпустить новые очки, поскольку Quest третьего поколения не имеют систем отслеживания глаз и лица. Они были в Quest Pro, но их выпуск прекратили в начале 2025 года.

Одна из возможностей обойти ограничения заключается в выпуске базовой версии Codec Avatars с имитацией отслеживания лица нейросетями по косвенным движениям и звукам, чтобы улучшить видеозвонки в WhatsApp и Messenger по сравнению с нынешними аватарами.

*В России признана экстремистской

Не пропускайте важнейшие новости о дополненной и виртуальной реальности — подписывайтесь на Голографику в Telegram, ВК и Twitter! Поддержите проект на Boosty.

Далее: Новый Помощник в редакторе миров Horizon Worlds может генерировать интерактивные объекты по описанию